GPU 클러스터 효율성·고속 인터커넥트 한계 돌파…

실제 워크로드 검증으로 AI 인프라 신뢰성 확보

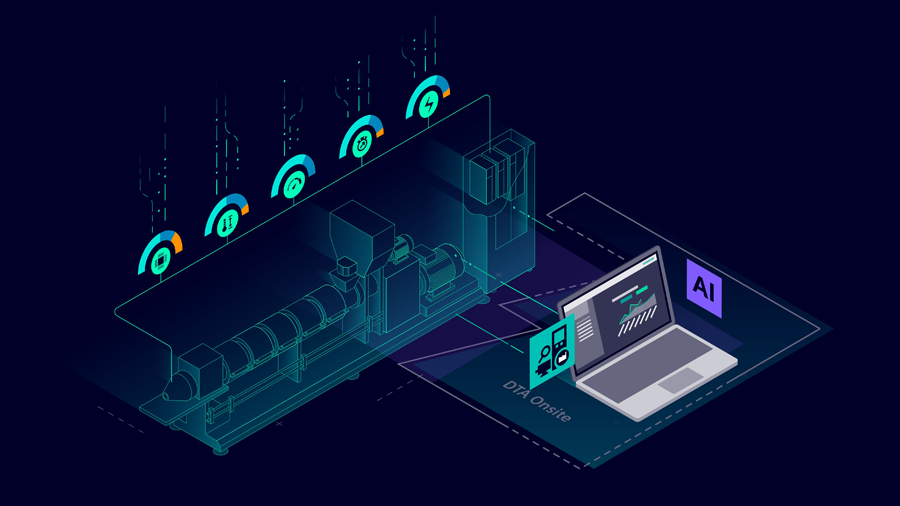

[아이씨엔 오승모 기자] 급증하는 AI 연산 수요 속에서 데이터센터 운영사들은 GPU 클러스터 간 통신 지연, 1.6T급 초고속 인터커넥트 신뢰성 부족, 에너지 효율성 저하라는 삼중고에 직면해 있으며, 키사이트의 KAI 아키텍처는 이러한 문제들을 시스템 차원에서 진단·해결하는 통합 플랫폼으로 주목받고 있다.

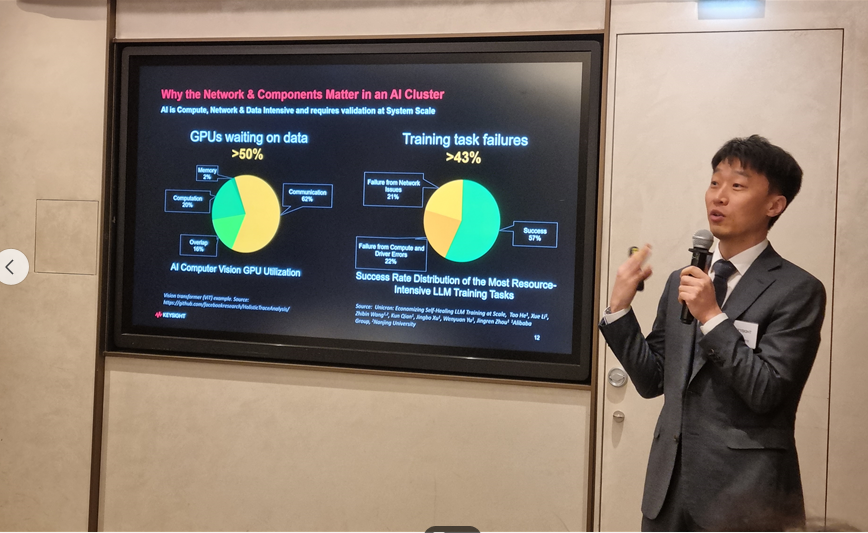

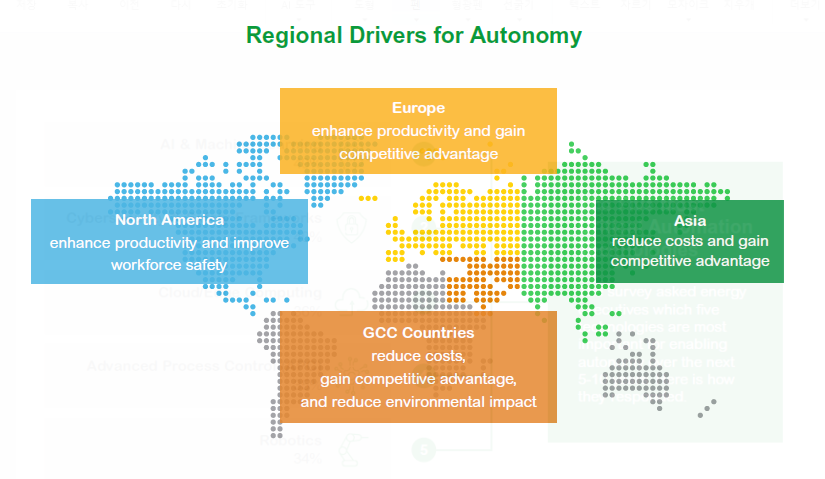

메타와 구글을 비롯한 선두 기업들은 이미 AI 학습 효율을 높이기 위해 모델 병렬화(Model Parallelism) 전략을 도입했지만, 네트워크 토폴로지와의 불일치로 인해 GPU 활용도가 40% 미만으로 떨어지는 경우가 빈번했는데, 키사이트의 KAI 데이터센터 빌더는 실제 LLM(대형 언어 모델) 학습 패턴을 시뮬레이션해 최적의 네트워크 구성을 제안함으로써 이 문제를 해결한다.

키사이트 코리아 김도호 차장은 “최근 AI 트렌드인 AI 애플리케이션의 트레이닝 학습에서 실제 GPU가 데이터를 처리함에 있어 어려움이 GPU간의 통신, 서버간의 통신에서 발생하는 네트워크 이슈가 문제로 확인되고 있다. 이러한 네트워크 이슈가 GPU의 효율성을 떨어뜨리고 대기시간을 늘리는데 큰 영향을 준다.”고 밝혔다. “점점 복잡해져 가는 AI 데이터센터 상에서의 설비와 디바이스간의 네트워크가 GPU의 성능과 효율을 결정하기 때문에, 이러한 것들을 효율화하고 최적화는 것이 필요하다. KAI 데이터센터 빌더는 전체 AI 데이터센터를 효율적으로 운영할 수 있도록 애뮬레이션 할 수 있는 플랫폼이다.”고 말했다.

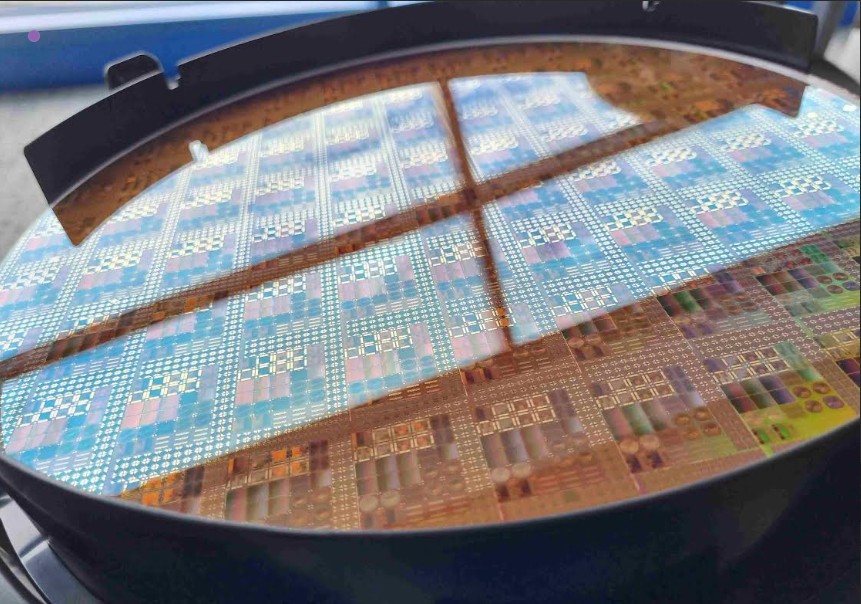

반도체 업계가 1.6T 광 인터커넥트 상용화를 앞두고 있는 가운데, 신호 간섭과 열 관리 문제가 새로운 장벽으로 부상했으며, 키사이트는 DCA-M 샘플링 오실로스코프를 통해 240Gbps/레인의 광 신호 정밀 분석을 지원해 엔지니어들이 생산 현장에서도 초고속 트랜시버의 결함을 신속하게 탐지할 수 있도록 했다.

“단일 부품 검증으로는 AI 클러스터 성능을 보장할 수 없다”는 키사이트의 설명처럼, 마이크로소프트 Azure는 최근 자사 데이터센터에 엔드투엔드 트래픽 에뮬레이션 기술을 도입해 네트워크 병목 현상을 사전에 차단했으며, KAI 아키텍처는 이러한 산업계 움직임에 부합하는 유일한 검증 솔루션으로 평가받고 있다.

키사이트 측은 “AI 인프라의 복잡성이 커질수록 실제 워크로드 재현과 시스템 수준 테스트가 필수적”이라며, “KAI 아키텍처가 AI 데이터센터의 설계부터 운영까지 전 주기적 최적화를 가능하게 할 것”이라고 강조했다.

![[전문가기고] K-배터리 3사, ‘Beyond EV’ 시장을 향한 기술 초격차 전략 비교 [인터배터리 2026] [전문가기고] K-배터리 3사, ‘Beyond EV’ 시장을 향한 기술 초격차 전략 비교 [인터배터리 2026]](https://icnweb.kr/wp-content/uploads/2026/03/battery-P3-beyond-Battery-web-1024x576.png)

![[심층기획] 피지컬 AI의 심장 ‘이차전지’, 휴머노이드 로봇 혁명 이끈다 [인터배터리 2026] [심층기획] 피지컬 AI의 심장 ‘이차전지’, 휴머노이드 로봇 혁명 이끈다 [인터배터리 2026]](https://icnweb.kr/wp-content/uploads/2026/03/Battery-pack-interB-Phy-AI.png)

![[칼럼] 제조업 생존 가르는 EU CRA와 피지컬 AI 보안 전략 [칼럼] 제조업 생존 가르는 EU CRA와 피지컬 AI 보안 전략](https://icnweb.kr/wp-content/uploads/2026/03/CRA-2026-notebookLM-20260326-1024web.png)

![[그래프] 국회의원 선거 결과 정당별 의석수 (19대-22대) 대한민국 국회의원 선거 결과(정당별 의석 수)](https://icnweb.kr/wp-content/uploads/2025/04/main-image-vote-flo-web-2-324x160.jpg)

![[#HM24] HARTING, 미래 핵심인 전기에너지에 열정을 쏟다 [#HM24] HARTING, 미래 핵심인 전기에너지에 열정을 쏟다](https://icnweb.kr/wp-content/uploads/2024/04/HM24-HARTING_TECO-2030-900web.jpg)

![[#HM24] 안전한 데이터 교환의 상생적 이점 [#HM24] 안전한 데이터 교환의 상생적 이점](https://icnweb.kr/wp-content/uploads/2024/04/roseman-labs-hm24_3_2-1024x683.jpg)

![[#HM24] 벡호프, AI 모델 생성을 간소화하는 AutoML 도구 출시 [#HM24] 벡호프, AI 모델 생성을 간소화하는 AutoML 도구 출시](https://icnweb.kr/wp-content/uploads/2024/04/TwinCAT-ML-Creator-Dr-Fabian-web.png)