국내 최초 그룹 기술윤리위 출범부터 AI 리스크 관리 체계까지, 책임 있는 AI 생태계 구축 선도

카카오가 지난 9월 8일 국가인권위원회와 법무부 공동 개최로 열린 ‘기업과 인권 국제포럼’에 참여해 안전하고 책임 있는 AI(인공지능)를 위한 자사의 노력을 소개했다.

이번 포럼은 글로벌 규제 동향과 기업 사례 공유를 통해 인권 경영 전략을 모색하기 위해 마련됐으며, 유엔개발계획(UNDP), 유럽연합(EU) 등 국제기구와 시민사회, 전문가들이 참석했다.

카카오는 포럼의 세 번째 세션인 ‘규제와 자발적 조치를 활용한 스마트믹스 모범 사례’에서 발표를 진행했다. 하진화 AI Safety 시니어 매니저가 ‘AI 기술과 인권 존중’을 주제로 AI 윤리 원칙 및 리스크 관리 체계 수립 관련 사례들을 발표했다.

체계적 AI 윤리·안전성 정책 마련 및 실행

카카오는 2022년 국내 기업 최초로 ‘그룹 기술 윤리 위원회’를 출범했으며, 계열사와 함께 기술 윤리 점검, AI 윤리 규정 준수 여부, 위험성 점검, 알고리즘 투명성 강화 등을 위한 업무를 수행 중이다. 위원회 활동을 담은 ‘그룹 기술 윤리 보고서’는 매년 발행되고 있다.

또한 ▲카카오 그룹의 책임 있는 AI를 위한 가이드라인 제정 ▲책임 있는 AI를 위한 생애주기별 자가점검 도구 개발 ▲AI 리스크 관리 체계 ‘카카오 AI Safety Initiative(Kakao ASI)’ 구축 등 기술 윤리와 AI 안전성 확보 노력을 지속하고 있다.

최근에는 AI 가드레일 모델 ‘카나나 세이프가드(Kanana Safeguard)’를 개발해 국내 기업 최초로 오픈소스로 공개했으며, 글로벌 오픈소스 커뮤니티 ‘AI 얼라이언스(AI Alliance)’에도 국내 최초로 가입한 바 있다.

디지털 아동·청소년 보호 정책 고도화

이날 발표에서는 카카오 그룹이 올해 도입한 ‘디지털 아동·청소년 보호 체크리스트’ 사례도 소개됐다.

해당 체크리스트는 국내 청소년 보호법과 유엔아동권리협약(UNCRC), 유니세프의 ‘디지털아동영향평가도구(UNICEF D-CRIA)’를 기준으로 제작됐다. AI 서비스 출시 및 개편에 앞서 관련 리스크를 사전 점검하기 위한 목적으로, 서비스 담당자가 ▲리스크 점검 ▲리스크 완화조치 ▲고충처리 이행 여부를 확인하고, 아동·청소년 보호 책임자가 ▲정책 및 거버넌스 ▲이해관계자 협력 등을 확인하는 문항으로 구성됐다.

카카오 이상호 그룹 기술윤리 소위원장은 “카카오는 지난 2018년 국내기업 최초로 알고리즘 윤리헌장을 발표하는 등 이용자 보호를 위해 노력해왔다”며 “AI 서비스의 성장은 인권과 프라이버시 등 사회 속 민감한 영역과 맞닿아 있으며, 기업 차원의 책임 의식 확산과 내재화를 위해 최선을 다할 것”이라고 말했다.

![[전문가기고] K-배터리 3사, ‘Beyond EV’ 시장을 향한 기술 초격차 전략 비교 [인터배터리 2026] [전문가기고] K-배터리 3사, ‘Beyond EV’ 시장을 향한 기술 초격차 전략 비교 [인터배터리 2026]](https://icnweb.kr/wp-content/uploads/2026/03/battery-P3-beyond-Battery-web-1024x576.png)

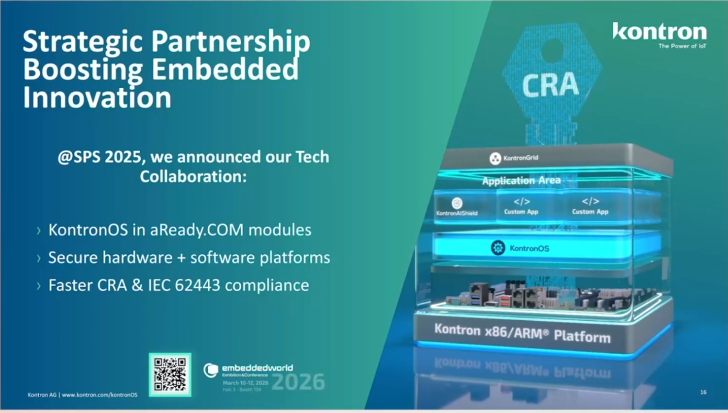

![[칼럼] 제조업 생존 가르는 EU CRA와 피지컬 AI 보안 전략 [칼럼] 제조업 생존 가르는 EU CRA와 피지컬 AI 보안 전략](https://icnweb.kr/wp-content/uploads/2026/03/CRA-2026-notebookLM-20260326-1024web.png)

![[그래프] 국회의원 선거 결과 정당별 의석수 (19대-22대) 대한민국 국회의원 선거 결과(정당별 의석 수)](https://icnweb.kr/wp-content/uploads/2025/04/main-image-vote-flo-web-2-324x160.jpg)